تاریخ انتشار : ۱۳۹۹/۱۲/۱۵ ساعت ۱۶:۵۹

کد مطلب : ۲۵۹۸۹۴

وقتی احراز هویت به یک شوخی تبدیل میشود!

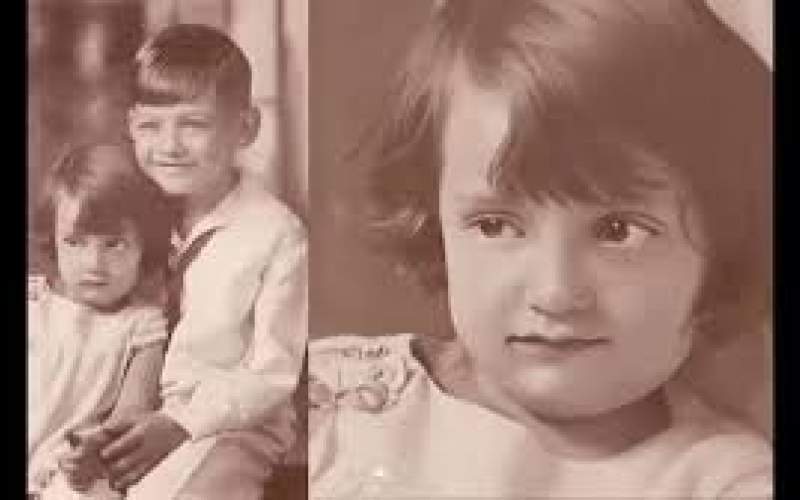

گروه فناوری: توضیح دادن حجم احساساتی که بعد از دیدن زنده شدن عکس قدیمی یکی از عزیزان از دست رفتهمان تنها با زدن یک دکمه تجربه میکنیم کار دشواری است. در حالی که به گونهای چشمک میزند و سرش را تکان میدهد که انگار همین دیروز زنده بوده است و سالها پیش یعنی قبل از آنکه فیلمبرداری به امری عادی تبدیل شود، از دنیا نرفته است.به گزارش ایسنا، این تصاویر متحرک که احساساتی ناراحت کننده و کمی هیجان انگیز ایجاد میکند توسط برنامه هوش مصنوعی به نام "نوستالژی عمیق" (Deep Nostalgia) ساخته میشوند که از پلتفرم "مای هریتج"(MyHeritage) آمده است.

فناوری ساخت این تصاویر با هوش مصنوعی پیچیده نیست. از کاربران دعوت میشود تا عکسهای قدیمی افراد محبوبشان را ارائه دهند تا این برنامه با استفاده از یادگیری عمیق حرکاتی از پیش تعیین شده را بر روی بخشهای صورت آنها اعمال کند.این برنامه همچنین لحظاتی که در تصویر اصلی ثبت نشده مانند لبخند با دندانهای پیدا و بخشهای کناری سر را نیز ایجاد میکنند و همهی اینها تصویری میسازند که شاید کاملا طبیعی نباشد اما عمیقا تاثیرگذارند.پاسخ ما به این تصاویر نوستالژیک میتواند ریختن اشک به دیدن تصویر لبخند زدن مادربزرگ و یا احساس عجیب از دیدن یک شخصیت تاریخی باشد.

هینی فرید(Hany Farid)، مدیر دانشکده اطلاعات دانشگاه برکلی(Berkeley) میگوید: هنگامی که ما مادربزرگ یا پدربزرگمان را زنده میبینیم احساس خارقالعادهای به ما دست میدهد که کمی ترسناک نیز هست. مغز پیچیده ما از مدتها قبل به چیزهایی که تقریبا مشابه انسان هستند اما انسان نیستند واکنش نشان میدهد. این واکنش به نام "درهی وهمی"(uncanny valley) شناخته میشود و دیپ فیکها و تصاویری که به وسیلهی هوش مصنوعی ساخته شدهاند این بخش زنگ خطر قدیمی مغز را به صدا درمیآورند.

حتی برنامهی "MyHeritage" نیز این موضوع را توضیح داده است و نوشته: اگرچه نتایج میتواند بحثبرانگیز باشد و سخت است که نسبت به این فناوری بیتفاوت باشیم اما هنگامی که یکی از کسانی که دوست داریم در محیطی کمی واقعی قرار میگیرد هر دو بخش مغز ما که مسئول ترس و عشق هستند فعال میشوند حتی اگر بدانیم که چیزی که به آن نگاه میکنیم واقعی نیست.فرید میگوید: مغز ما تصاویر افراد را متفاوت از اشیاء بیجان پردازش میکند این موضوع در شبکهی عصبی ما انجام میشود.لا مار جورل بروس(La Marr Jurelle Bruce)، استاد دانشگاه مریلند که تصویری متحرک از فردریک داگلاس(یکی از رهبران بزرگ ضد برده داری در آمریکا) به اشتراگ گذاشت و توجه بسیاری را جلب کرد میگوید: احساس شگفتی من با کمی احساس ترس همراه بود.

"دیپ فیکها"(Deepfakes) که ترکیبی از تصویر و صدا هستند برای سالها مورد بحث اخلاقگرایان در حوزه دیجیتال بودهاند مخصوصا زمانی که این موضوع در ساخت فیلمهای جعلی و هرزه نگاری استفاده شود میتواند موسسات ملی و مالی را تهدید کند.قضیه وقتی خطرناکتر میشود که تصور کنیم با پیشرفت فناوری "دیپفیک" چه سوءاستفادههایی میتوان از این فناوری انجام داد تا جایی که شاید روزی مقوله هویت و احراز آن به یک شوخی تبدیل شود.برای استفاده مثبت از این فناوری شرکتها از آن برای ساخت کمپینهای تبلیغاتی استفاده میکنند که برای افراد شخصیسازی شده است. به گفتهی متخصصان بازده تبلیغات زمانی بیشتر میشود که مصرفکننده با آن برند یا محصول ارتباط بیشتری برقرار کند و ببیند که آن محصول به گونهای خاص در زندگیاش نقش دارد و مدلی شبیه به خودش و با زبان خودش آن را نمایش میدهد.هچنین برنامههایی ارتباطی مشابه "نوستالژی عمیق" ایجاد میکنند اما در حقیقت هیچ چیز انسانی در هوش مصنوعی وجود ندارد.

"فرید" تاکید میکند که یادگیری ماشینی که به گسترش فناوریهای متحرک ساز کمک میکند مانند فناوری "نوستالژی عمیق" بخشی از دنیای بزرگ هوشهای مصنوعی است. یادگیری ماشینی دادهها را با دقت بررسی میکند و الگوها را پیدا میکند. در حالی که یک برنامه با دریافت اطلاعات بیشتر میتواند پیشرفت کند اما هیچ هوش یا تجزیه و تحلیلی در نحوهی استفاده از این الگوها وجود ندارد. اپلیکیشنهای زیادی وجود دارند که از این دادهها سود زیادی میبرند.ایجاد گرافیک رایانهای هوشهای مصنوعی از صورت انسانها خطری دیگر برای امنیت ما در محیط مجازی است اگرچه گاهی هم ایرادات آن هنگامی که نمیداند با بخشهای غیر عادی مثل عینک و گوشها چه کند خندهدار است و حتی در پیچیدهترین "دیپ فیک"ها مثل دیپ فیک تام کروز(Tom Cruise) نیز تناقضهای جزئی وجود دارد که باعث میشود به حقیقت آن شک کنیم. با این حال این مشکلات جزئی با پیشرفت این فناوری از بین خواهند رفت و فرید میگوید زمان آن رسیده تا شرکتها به پیامدهای اخلاقی این فناوری نگاهی نقادانه داشته باشند.او افزود: ما باید ساختن چنین چیزهایی را متوقف کنیم و در مورد آنها سوال کنیم پیش از آن که خیلی دیر شود.

برنامهی "نوستالژی عمیق" MyHeritage پیش از استفاده به افراد در مورد استفاده بدون اجازه از عکس دیگران هشدار میدهد و میگوید برای حفظ امنیت افراد این شرکت گزینهی افزودن صدا به تصاویر قرار نداده است.

در آینده شاید برنامههای دیگری این خللها را پر کنند تا ما بتوانیم افرادی که برای مدتها ندیدهایم را ببینیم با آنها صحبت کنیم. چنین فناوری چالشهای فراوانی در برابر امنیت و باورپذیری خواهد داشت اما هنگامی که میبینیم کسانی که دوستشان داریم به ما لبخند میزنند مقاومت در برابر این فناوری بسیار دشوار خواهد شد.

فناوری ساخت این تصاویر با هوش مصنوعی پیچیده نیست. از کاربران دعوت میشود تا عکسهای قدیمی افراد محبوبشان را ارائه دهند تا این برنامه با استفاده از یادگیری عمیق حرکاتی از پیش تعیین شده را بر روی بخشهای صورت آنها اعمال کند.این برنامه همچنین لحظاتی که در تصویر اصلی ثبت نشده مانند لبخند با دندانهای پیدا و بخشهای کناری سر را نیز ایجاد میکنند و همهی اینها تصویری میسازند که شاید کاملا طبیعی نباشد اما عمیقا تاثیرگذارند.پاسخ ما به این تصاویر نوستالژیک میتواند ریختن اشک به دیدن تصویر لبخند زدن مادربزرگ و یا احساس عجیب از دیدن یک شخصیت تاریخی باشد.

هینی فرید(Hany Farid)، مدیر دانشکده اطلاعات دانشگاه برکلی(Berkeley) میگوید: هنگامی که ما مادربزرگ یا پدربزرگمان را زنده میبینیم احساس خارقالعادهای به ما دست میدهد که کمی ترسناک نیز هست. مغز پیچیده ما از مدتها قبل به چیزهایی که تقریبا مشابه انسان هستند اما انسان نیستند واکنش نشان میدهد. این واکنش به نام "درهی وهمی"(uncanny valley) شناخته میشود و دیپ فیکها و تصاویری که به وسیلهی هوش مصنوعی ساخته شدهاند این بخش زنگ خطر قدیمی مغز را به صدا درمیآورند.

حتی برنامهی "MyHeritage" نیز این موضوع را توضیح داده است و نوشته: اگرچه نتایج میتواند بحثبرانگیز باشد و سخت است که نسبت به این فناوری بیتفاوت باشیم اما هنگامی که یکی از کسانی که دوست داریم در محیطی کمی واقعی قرار میگیرد هر دو بخش مغز ما که مسئول ترس و عشق هستند فعال میشوند حتی اگر بدانیم که چیزی که به آن نگاه میکنیم واقعی نیست.فرید میگوید: مغز ما تصاویر افراد را متفاوت از اشیاء بیجان پردازش میکند این موضوع در شبکهی عصبی ما انجام میشود.لا مار جورل بروس(La Marr Jurelle Bruce)، استاد دانشگاه مریلند که تصویری متحرک از فردریک داگلاس(یکی از رهبران بزرگ ضد برده داری در آمریکا) به اشتراگ گذاشت و توجه بسیاری را جلب کرد میگوید: احساس شگفتی من با کمی احساس ترس همراه بود.

"دیپ فیکها"(Deepfakes) که ترکیبی از تصویر و صدا هستند برای سالها مورد بحث اخلاقگرایان در حوزه دیجیتال بودهاند مخصوصا زمانی که این موضوع در ساخت فیلمهای جعلی و هرزه نگاری استفاده شود میتواند موسسات ملی و مالی را تهدید کند.قضیه وقتی خطرناکتر میشود که تصور کنیم با پیشرفت فناوری "دیپفیک" چه سوءاستفادههایی میتوان از این فناوری انجام داد تا جایی که شاید روزی مقوله هویت و احراز آن به یک شوخی تبدیل شود.برای استفاده مثبت از این فناوری شرکتها از آن برای ساخت کمپینهای تبلیغاتی استفاده میکنند که برای افراد شخصیسازی شده است. به گفتهی متخصصان بازده تبلیغات زمانی بیشتر میشود که مصرفکننده با آن برند یا محصول ارتباط بیشتری برقرار کند و ببیند که آن محصول به گونهای خاص در زندگیاش نقش دارد و مدلی شبیه به خودش و با زبان خودش آن را نمایش میدهد.هچنین برنامههایی ارتباطی مشابه "نوستالژی عمیق" ایجاد میکنند اما در حقیقت هیچ چیز انسانی در هوش مصنوعی وجود ندارد.

"فرید" تاکید میکند که یادگیری ماشینی که به گسترش فناوریهای متحرک ساز کمک میکند مانند فناوری "نوستالژی عمیق" بخشی از دنیای بزرگ هوشهای مصنوعی است. یادگیری ماشینی دادهها را با دقت بررسی میکند و الگوها را پیدا میکند. در حالی که یک برنامه با دریافت اطلاعات بیشتر میتواند پیشرفت کند اما هیچ هوش یا تجزیه و تحلیلی در نحوهی استفاده از این الگوها وجود ندارد. اپلیکیشنهای زیادی وجود دارند که از این دادهها سود زیادی میبرند.ایجاد گرافیک رایانهای هوشهای مصنوعی از صورت انسانها خطری دیگر برای امنیت ما در محیط مجازی است اگرچه گاهی هم ایرادات آن هنگامی که نمیداند با بخشهای غیر عادی مثل عینک و گوشها چه کند خندهدار است و حتی در پیچیدهترین "دیپ فیک"ها مثل دیپ فیک تام کروز(Tom Cruise) نیز تناقضهای جزئی وجود دارد که باعث میشود به حقیقت آن شک کنیم. با این حال این مشکلات جزئی با پیشرفت این فناوری از بین خواهند رفت و فرید میگوید زمان آن رسیده تا شرکتها به پیامدهای اخلاقی این فناوری نگاهی نقادانه داشته باشند.او افزود: ما باید ساختن چنین چیزهایی را متوقف کنیم و در مورد آنها سوال کنیم پیش از آن که خیلی دیر شود.

برنامهی "نوستالژی عمیق" MyHeritage پیش از استفاده به افراد در مورد استفاده بدون اجازه از عکس دیگران هشدار میدهد و میگوید برای حفظ امنیت افراد این شرکت گزینهی افزودن صدا به تصاویر قرار نداده است.

در آینده شاید برنامههای دیگری این خللها را پر کنند تا ما بتوانیم افرادی که برای مدتها ندیدهایم را ببینیم با آنها صحبت کنیم. چنین فناوری چالشهای فراوانی در برابر امنیت و باورپذیری خواهد داشت اما هنگامی که میبینیم کسانی که دوستشان داریم به ما لبخند میزنند مقاومت در برابر این فناوری بسیار دشوار خواهد شد.